回归係数

回归係数(regression coefficient)在回归方程中表示自变数x 对因变数y 影响大小的参数。回归係数越大表示x 对y 影响越大,正回归係数表示y 随x 增大而增大,负回归係数表示y 随x增大而减小。例如回归方程式Y=bX+a中,斜率b称为回归係数,表示X每变动一单位,平均而言,Y将变动b单位。

基本介绍

- 中文名:回归係数

- 外文名:regression coefficient

- 定义:表示回归方程x对y影响程度的参数

- 相关:相关係数

- 一级学科:数学

- 二级学科:统计学

回归係数

对于回归係数的解释,需要从线性回归模型当中来定义。

线性回归模型是一种特殊的线性模型。若变数y与变数 的关係表示为

的关係表示为 ,且

,且

称f(x)为y对x的回归,f(x)称为回归函式。通常在常态分配情形,若f(x)是x的线性函式 ,此时称为线性回归,

,此时称为线性回归, 称为回归常数,

称为回归常数, 称为回归係数(regression coefficient)。取y为n个观测,得观测值向量

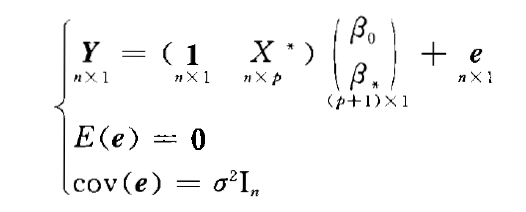

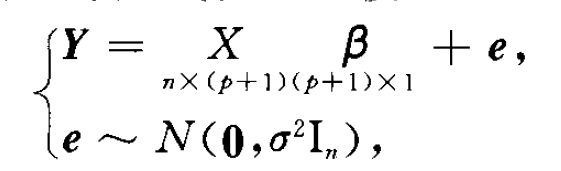

称为回归係数(regression coefficient)。取y为n个观测,得观测值向量 ,表示为如下模型:

,表示为如下模型:

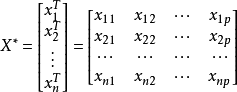

其中1是坐标全为1的向量, 为n阶单位阵,记

为n阶单位阵,记 ,且假定

,且假定 这个矩阵的秩为p+1,而记

这个矩阵的秩为p+1,而记

这里β,σ2为未知参数,e(n×1)是随机向量。

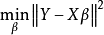

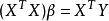

最小二乘估计

回归係数的最小二乘估计(least square estimator of regression coefficient)简称LS估计。参数估计的一种方法。线性回归模型中,未知参数β的最小二乘估计为满足

显着性检验

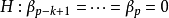

回归係数显着性检验(significant test of regression coefficient)是检验某些回归係数是否为零的假设检验。考虑线性回归模型

不失一般性,可假定要检验后k个(1≤k≤p)回归係数是否为零,即 。一般用F统计量

。一般用F统计量

去检验,这里 是上述模型的残差平方和,

是上述模型的残差平方和, 为假定后k个係数为零时(即少了k个自变数)的模型的残差平方和。用F检验有许多优良性,在这方面,中国统计学家许宝騄早期做了许多工作,后来美籍罗马尼亚数学家瓦尔德(Wald,A.)发展了他的工作。

为假定后k个係数为零时(即少了k个自变数)的模型的残差平方和。用F检验有许多优良性,在这方面,中国统计学家许宝騄早期做了许多工作,后来美籍罗马尼亚数学家瓦尔德(Wald,A.)发展了他的工作。

理解

1、相关係数与回归係数:

A 回归係数大于零则相关係数大于零

B 回归係数小于零则相关係数小于零

(它们的取值符号相同)

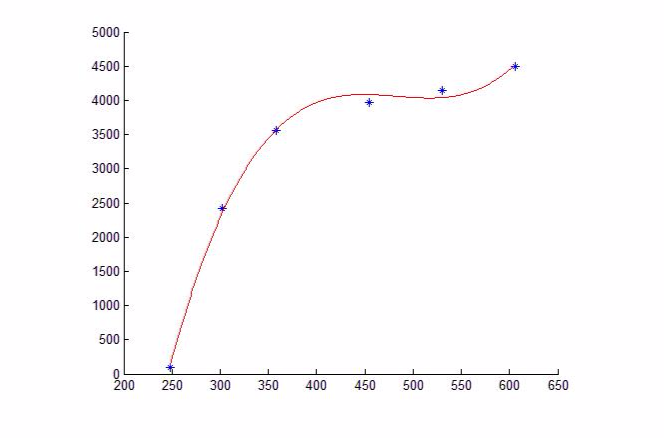

2、回归係数:由回归方程求导数得到,

所以,回归係数>0,回归方程曲线单调递增;

回归係数<0,回归方程曲线单调递减;

回归係数=0,回归方程求最值(最大值、最小值)。

读书笔记摘抄新闻资讯

读书笔记摘抄新闻资讯